Обучение генеративной нейросети по личному архиву пленочных снимков

Идея проекта

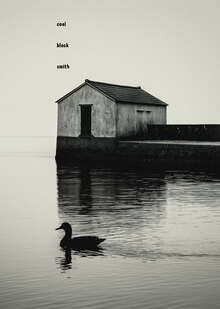

В основе данного проекта лежит мой личный фотоархив — почти сотня самых удачных кадров, снятых на пленку в годы моего подросткового возраста. Этот специфичный процесс съемки был моим главным инструментом для установки связи и диалога с миром. Я снимала все: своих друзей в моменты беззаботности и посиделок в кафе, животных в их естественной среде, путешествия, культурную жизнь родного города: концерты локальных групп и визиты в музей.

Замысел заключается в том, чтобы обучить генеративную нейросеть создать цифрового «двойника» снимкам и моей творческой интуиции того периода, научить искусственный интеллект понимать и генерировать изображения, которые продолжали бы эстетическую и эмоциональную линию моего архива.

Подготовка окружения

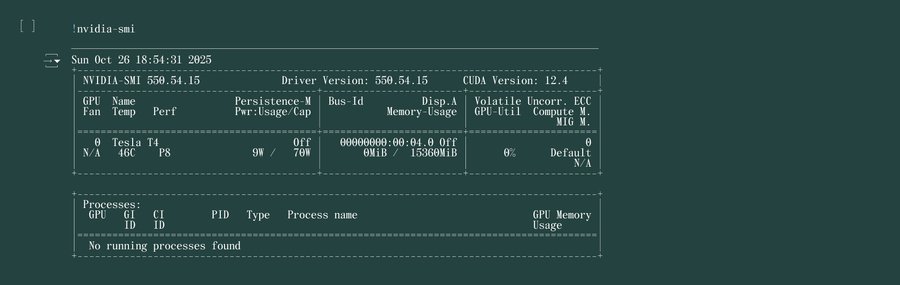

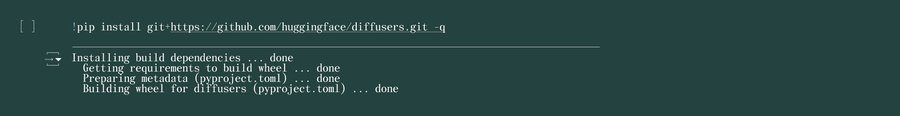

Настраиваю среду, загружая все необходимые инструменты и инструкции для работы.

Сначала выполняю диагностику аппаратных возможностей через проверку GPU, затем устанавливается ключевое программное обеспечение, основная библиотека для моделей ИИ, а также специализированный фреймворк, позволяющий адаптировать большую модель под задачи без гигантских затрат ресурсов.

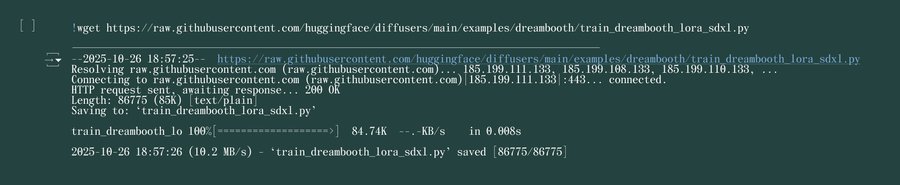

Далее подключаю актуальную версию библиотеки для работы с диффузионными моделями — основным инструментом генерации изображений. Напоследок: скрипт для обучения по методу Dreambooth с технологией LoRA, который является детализированной инструкцией для «вписывания» моего визуального стиля в готовую модель.

Подготовка датасета

Данный блок кода отвечает за создание и наполнение датасета для обучения — те самые пленочные фотографии, которые станут основой для стиля нейросети.

*Кадры отсняты на «Зенит», Olympus и Konica с пленкой Kodak.

Генерация подписей к изображениям

На этом этапе код автоматически создает текстовые описания для каждого фото, используя модель компьютерного зрения BLIP: система анализирует содержимое изображений и генерирует к ним английские подписи, к которым добавляет стилевой маркер «photo in my style», после чего все пары «файл-описание» сохраняются в файл metadata.jsonl, формируя основной датасет для последующего обучения нейросети, а затем модель BLIP выгружается из памяти для освобождения ресурсов GPU.

Подготовка окружения к обучению

В данном этапе на Hugging Face беру токен для обучения нейросети, вношу его в среду для программирования.

Обучение модели

Сохранение на Hugging Face

Генерация изображений

Код автоматически определяет мое имя пользователя на Hugging Face, создает новый репозиторий для модели, генерирует информационную карточку с метаданными обучения, загружает все файлы обученного LoRA-адаптера в созданный репозиторий на платформу.

Результаты генераций

Описание применения генеративной модели

Обученной генеративной нейросети удалось в общих чертах воспроизводить эстетику и атмосферу моего пленочного архива — характерный цвет и композиционное построение кадра. Ключевым ограничением оказался этап автоматической генерации подписей к изображениям: BLIP-модель, без последующей доработки в ChatGPT, выдает довольно сухие и обобщенные описания.

Итоги обучения

Нейросети тяжело дается воспроизведение уникальных черт конкретного человека — сложных причесок, объема губ или цвета бровей. Модель хорошо улавливает «настроение» портрета, но создает обобщенные образы, а не точные копии людей. А также не получилось натуралистично повторить «зерно» на изображениях, жесткую заполняющую вспышку или случайные дефекты пленки (мушки, засветы).

Однако модель блестяще показала себя в создании пейзажей и изображения животных: она выдает отличные результаты, убедительно воссоздает «магию» и тепло аналоговой фотографии, которые я стремилась в нее заложить.